BLOG

NREL lanza un proyecto de almacenamiento geotérmico para abordar los niveles de consumo de energía de refrigeración del centro de datos

El Laboratorio Nacional de Energía Renovable (NREL), un centro de investigación financiado con fondos federales, ha lanzado un nuevo proyecto para abordar el creciente consumo de energía en la refrigeración de los centros de datos.

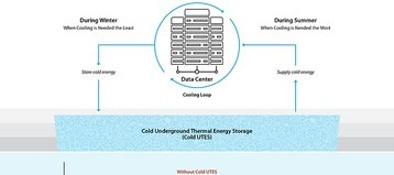

El proyecto, financiado por la Oficina de Tecnologías Geotérmicas del Departamento de Energía de EE. UU., incorporará tecnología de almacenamiento de energía térmica subterránea (UTES) geotérmica en sitios de centros de datos de todo el país.

Según el NREL, los sistemas de refrigeración tradicionales (que enfrían los servidores mediante aire frío o refrigeración líquida) representan hasta el 40 por ciento del consumo energético anual del centro de datos.

En comparación, las tecnologías geotérmicas como el proyecto Cold Underground Thermal Energy Storage (Cold UTES) utilizan energía fuera de horas pico para crear reservas subterráneas de energía fría, que pueden incorporarse a los sistemas de enfriamiento de centros de datos existentes y usarse durante las horas pico de carga de la red, lo que reduce el consumo de energía.

Los principales objetivos del proyecto son reducir la presión sobre la red de los centros de datos, reducir el coste energético de los centros de datos y reducir el coste de los sistemas de refrigeración de los centros de datos. El proyecto pretende, en última instancia, demostrar cómo Cold UTES puede ser una solución comercial y técnicamente viable para grandes cargas de refrigeración de centros de datos.

Supermicro ofrece arquitectura refrigerada por aire y por líquido de próxima generación para la plataforma NVIDIA Blackwell

SAN JOSÉ, California, 5 de febrero de 2025 /PRNewswire/ -- Supermicro, Inc. (NASDAQ: SMCI), un proveedor de soluciones de TI totales para IA/ML, HPC, nube, almacenamiento y 5G/Edge, anuncia la disponibilidad de producción total de sus Building Block Solutions® de centro de datos de IA de extremo a extremo aceleradas por la plataforma NVIDIA Blackwell.

La cartera de productos Supermicro Building Block proporciona los elementos de infraestructura básicos necesarios para escalar las soluciones Blackwell con un tiempo de implementación excepcional. La cartera incluye una amplia gama de sistemas refrigerados por aire y por líquido con múltiples opciones de CPU.

Los sistemas NVIDIA HGX B200 de 8 GPU de Supermicro utilizan tecnología de refrigeración líquida y por aire de última generación. Las placas de refrigeración de nuevo desarrollo y la nueva unidad de distribución de refrigerante (CDU) de 250 kW duplican con creces la capacidad de refrigeración de la generación anterior en el mismo formato de 4U.

El nuevo sistema NVIDIA HGX B200 de 10U con refrigeración por aire cuenta con un chasis rediseñado con un margen térmico ampliado para alojar ocho GPU Blackwell de 1000 W TDP. Se pueden instalar hasta 4 de los nuevos sistemas de 10U con refrigeración por aire e integrarlos completamente en un rack, la misma densidad que la generación anterior, al tiempo que se proporciona un rendimiento de inferencia hasta 15 veces superior y un rendimiento de entrenamiento tres veces superior.

Los nuevos diseños SuperCluster incorporan redes Ethernet NVIDIA Quantum-2 InfiniBand o NVIDIA Spectrum-X en un rack centralizado, lo que permite una unidad escalable de 256 GPU sin bloqueo en cinco racks o una unidad escalable extendida de 768 GPU en nueve racks.

Blackstone defiende su visión de inversión en centros de datos, pero admite que sigue "muy de cerca" las preocupaciones sobre DeepSeek

Blackstone adoptó una postura defensiva en su última conferencia de ganancias después de que DeepSeek de China provocara la caída de las acciones tecnológicas.

Después de haber utilizado previamente la llamada para promover los beneficios de la infraestructura de IA, el tema no se abordó hasta que Morgan Stanley preguntó sobre las preocupaciones sobre la construcción de centros de datos instigadas por DeepSeek.

El modelo más eficiente de la empresa china de inteligencia artificial ha llevado a muchos a cuestionar la lógica de construir centros de datos cada vez más grandes para entrenar modelos cada vez más grandes.

Jon Gray, director de operaciones de Blackstone, afirmó que DeepSeek formaba parte de una tendencia más amplia, en la que "el coste de la computación está bajando drásticamente, pero al mismo tiempo eso va a llevar a un mayor uso y una mayor adopción".

Blackstone, a través de QTS y otras inversiones, planea seguir "gastando grandes cantidades de dinero para construir estas cosas", pero sólo "en función de las señales de demanda de nuestros inquilinos".

John Gross, experto en refrigeración líquida, se incorpora a Prometheus Hyperscale como director de tecnología

Prometheus Hyperscale ha nombrado al experto en refrigeración líquida John Gross como CTO.

Gross ha estado trabajando con la empresa, que pretende construir un campus de centro de datos de 1 GW en Wyoming, durante los últimos cuatro años como consultor principal de ingeniería.

Después de comenzar su carrera en la puesta en servicio de centros de datos en Compaq Computer, Gross trabajó como ingeniero mecánico principal con clientes como ExxonMobil, HP y Valero Energy.

Se desempeña como secretario de la Sociedad Estadounidense de Ingenieros de Calefacción, Refrigeración y Aire Acondicionado (ASHRAE) TC9.9, preside el Subcomité de Refrigeración Líquida de ASHRAE SSPC 127 y es ex codirector del subproyecto de Instalaciones de Refrigeración Avanzadas del Proyecto Open Compute.

Prometheus Hyperscale, conocida anteriormente como Wyoming Hyperscale, está construyendo un campus de centro de datos en 58 acres de terreno en Aspen Mountain, un sitio remoto al sureste de Evanston en Wyoming. El plan es una idea original de Thornock, cuya familia es propietaria del terreno, y, en septiembre, la empresa incorporó a Trevor Neilson como presidente y cambió su nombre a Prometheus.

La empresa afirma que las instalaciones de Aspen Mountain serán "el centro de datos sostenible más avanzado de Estados Unidos" una vez que estén en funcionamiento, y ya se ha comprometido a utilizar refrigeración líquida y a aprovechar el calor residual en una granja cercana. En mayo, Prometheus llegó a un acuerdo para comprar 100 MW de energía a la pequeña empresa de reactores nucleares Oklo.

Intel registra su tercer trimestre consecutivo de pérdidas y cancela el lanzamiento previsto del chip de inteligencia artificial Falcon Shores

Intel está cancelando su acelerador de inteligencia artificial Falcon Shores en un esfuerzo por concentrar sus recursos después de que la compañía registrara un tercer trimestre consecutivo de caída de ingresos.

En el primer informe de ganancias desde que el ex CEO Pat Gelsinger dejó la compañía, los ingresos del cuarto trimestre de Intel cayeron un siete por ciento interanual a $ 14,3 mil millones, mientras que los ingresos del año completo disminuyeron un dos por ciento interanual a $ 53,1 mil millones.

Intel también vio sus ingresos trimestrales del Centro de datos e IA (DCAI) caer un tres por ciento interanual a $ 3.4 mil millones, sin embargo, los ingresos anuales para el segmento alcanzaron los $ 12.8 mil millones, un aumento del uno por ciento con respecto a 2023. Intel Foundry sufrió una historia similar, con ingresos del cuarto trimestre de 2024 que cayeron un 13 por ciento interanual a $ 4.5 mil millones y los ingresos anuales cayeron un siete por ciento a $ 17.5 mil millones.

La GPU Falcon Shores es un procesador híbrido diseñado para soportar aplicaciones de IA y HPC y aumentar el rendimiento y la eficiencia del rendimiento por vatio. Descrita por Intel como su primera oferta multichiplet, combina el hardware de GPU x86 y Xe en un solo chip de socket Xeon.

Tras los comentarios de Holthaus, su codirector ejecutivo y actual director financiero de Intel, David Zinsner, ofreció una actualización sobre la fundición de Intel y dijo a los analistas que la puesta en marcha de Intel 18A en la segunda mitad de 2025 "respaldará mayores volúmenes y una mejor rentabilidad en 2026".

Zinsner también reveló que Intel había recibido $1.100 millones de dólares en fondos de la Ley CHIPS del gobierno de EE. UU. en el cuarto trimestre del año fiscal 24 y $1.100 millones adicionales en enero del primer trimestre del año fiscal 25.

Francia y Emiratos Árabes Unidos invertirán miles de millones en un centro de datos de IA europeo de 1 GW

Francia y los Emiratos Árabes Unidos gastarán entre 30.000 y 50.000 millones de euros (entre 31.000 y 52.000 millones de dólares) en un centro de datos de IA de 1 GW y otras inversiones en IA.

Aún no se ha elegido una ubicación para el campus de IA, pero se construirá en algún lugar de Francia. Además del centro de datos, las dos empresas esperan invertir en chips, desarrollo de talentos y el establecimiento de embajadas de datos virtuales que conducirán a infraestructuras de IA y de nube soberanas en ambos países.

Aún no se ha elegido una ubicación para el campus de IA, pero se construirá en algún lugar de Francia. Además del centro de datos, las dos empresas esperan invertir en chips, desarrollo de talentos y el establecimiento de embajadas de datos virtuales que conducirán a infraestructuras de IA y de nube soberanas en ambos países.

Aún no se ha elegido una ubicación para el campus de IA, pero se construirá en algún lugar de Francia. Además del centro de datos, las dos empresas esperan invertir en chips, desarrollo de talentos y el establecimiento de embajadas de datos virtuales que conducirán a infraestructuras de IA y de nube soberanas en ambos países.

Equinix inaugura un centro de datos en París, Francia

Equinix ha lanzado oficialmente un nuevo centro de datos en París, Francia.

La instalación, que ha costado 350 millones de euros (361,4 millones de dólares), está situada en el número 9 de la Avenida du Marechal Juin y ocupa un espacio total de 7330 metros cuadrados distribuidos en 12 salas de datos. El edificio de 20 745 metros cuadrados (223 297 pies cuadrados) ofrece una potencia total de 28,8 MW.

PA13x, un solar industrial rehabilitado, se equipará con paneles fotovoltaicos que cubrirán aproximadamente 350 m2 (3767 pies cuadrados). Un techo insonorizante y paredes con aislamiento acústico reducirán el ruido.

En 2022, se prealquilaron unos 14 MW a PA13x. Según las presentaciones de resultados de Equinix, la primera fase de la instalación se lanzó silenciosamente en el cuarto trimestre de 2023. Una segunda fase de 14 MW, anunciada en el segundo trimestre de 2024, debía lanzarse oficialmente en el segundo trimestre de 2025, de los cuales 7 MW están arrendados.

En París, Equinix opera diez centros de datos (tres xScale y siete International Business Exchange (IBX)) que suman un total de aproximadamente 61 000 m² de superficie.

Equinix se asoció con el fondo soberano de riqueza GIC de Singapur en octubre de 2019 para desarrollar instalaciones de hiperescala bajo la etiqueta xScale y desde entonces se ha asociado con empresas como PGIM y Canada Pension Plan para implementar más de una docena de instalaciones de hiperescala a nivel mundial.

Google espera que el gasto de capital en 2025 aumente a 75.000 millones de dólares para la construcción de un centro de datos de IA

Google espera que el gasto de capital alcance los 75 mil millones de dólares este año, y la mayor parte se destinará a centros de datos, servidores y redes.

Eso es más de lo que Wall Street esperaba, 58.000 millones de dólares, y significativamente superior al gasto de capital de 52.500 millones de dólares de 2024.

Si bien los ingresos de Google Cloud alcanzaron casi 12 mil millones de dólares en el trimestre, un aumento del 30 por ciento, estuvieron por debajo de las expectativas de los analistas recopiladas por LSEG, que esperaban un aumento del 32,2 por ciento hasta los 12.160 millones de dólares.

Los ingresos operativos de Google Cloud fueron de 2.100 millones de dólares y el margen operativo aumentó del 9,4 por ciento al 17,5 por ciento año tras año.

Al igual que en la conferencia telefónica sobre las ganancias de Microsoft, los analistas plantearon el tema del modelo de bajo costo entrenado de la empresa china de inteligencia artificial DeepSeek, que provocó la caída de las acciones tecnológicas a principios de este año y puso en tela de juicio las enormes cantidades de inversión que se han invertido en inteligencia artificial.

Este año también se lanzó Stargate, la empresa de centros de datos de OpenAI, que prometió gastar 100 mil millones de dólares "inmediatamente".

El centro de datos de Meta en Mesa, Arizona, entra en funcionamiento

Meta ha puesto en funcionamiento su centro de datos en Mesa, Arizona.

Originalmente se había planeado que el centro de datos de Mesa entrara en funcionamiento en 2023, pero probablemente se retrasó como parte de una pausa más amplia en la construcción de Meta mientras rediseñaba las instalaciones para inteligencia artificial (IA).

En ese momento, Meta dijo que la instalación ocuparía más de 2,5 millones de pies cuadrados (232.300 metros cuadrados) en cinco edificios. Meta le dijo a DCD que dos de los edificios están actualmente en funcionamiento.

Se instalaron alrededor de 20.000 toneladas de acero, incluyendo acero estructural y vigas, y se vertieron 375.000 metros cúbicos de hormigón. La empresa afirmó que el 78 por ciento de los desechos de la construcción se desviaron a centros de reciclaje, lo que permitió que casi 28.474 toneladas no terminaran en vertederos.

Meta planea gastar entre 60 y 65 mil millones de dólares en centros de datos y gastos de capital más amplios este año, y está desarrollando una instalación de 2 GW en Luisiana. Esta semana, el director ejecutivo Mark Zuckerberg dijo que la empresa planea gastar "cientos de miles de millones de dólares" en infraestructura de inteligencia artificial a largo plazo.

TikTok invertirá 3.800 millones de dólares en un servicio de alojamiento de datos tailandés

TikTok Pte. Ltd, la unidad singapurense de la china ByteDance, invertirá 3.800 millones de dólares en "servicios de alojamiento de datos" en Tailandia.

La Junta de Inversiones de Tailandia anunció el 29 de enero que había aprobado el proyecto de infraestructura digital tailandés de TikTok, y al mismo tiempo aprobó un proyecto de 3.250 millones de baht (96,4 millones de dólares) de Siam AI Corporation para servicios de nube de inteligencia artificial.

TikTok proporcionará servicios de alojamiento de datos para "respaldar las actividades de las empresas afiliadas" y está previsto que las operaciones comiencen en 2026.

No se ha especificado si el servicio de alojamiento de datos se ofrecerá desde centros de datos desarrollados y propios de TikTok, o si la empresa tiene la intención de arrendar espacio en otros centros de datos para el servicio. Sin embargo, en octubre de 2024, surgieron informes de que la empresa matriz de TikTok, ByteDance, estaba considerando abrir un centro de datos en Tailandia para respaldar los servicios de nube e inteligencia artificial.

En septiembre de 2024, Google dijo que invertiría 1.000 millones de dólares en centros de datos en la capital, Bangkok, y en la cercana provincia costera de Chonburi, creando 14.000 puestos de trabajo en el proceso.

Como parte del proyecto, Google trabajará con Gulf Edge para crear una oferta de nube soberana en Tailandia.

AWS lanzó una región de nube en Tailandia a principios de este mes como parte de un plan para invertir 5 mil millones de dólares para 2037, mientras que Microsoft también planea construir una región de centros de datos en el país.

CoreWeave incorpora instancias Nvidia GB200 NVL72 a su plataforma en la nube

CoreWeave ahora ofrece instancias Nvidia GB200 NVL72 en su plataforma en la nube.

Las instancias generalmente están disponibles a través del servicio Kubernetes de CoreWeave, Slurm oN Kubernetes (SUNK) y la plataforma Mission Control.

Las instancias GB200 basadas en NVL72 en CoreWeave conectan 36 CPU Nvidia Grace y 72 GPU Nvidia Blackwell en un diseño a escala de rack refrigerado por líquido y están disponibles como instancias físicas a través de CoreWeave Kubernetes Service, y son escalables hasta 110 000 GPU.

CoreWeave afirma que es el primer proveedor de nube que ofrece instancias Nvidia GB200 NVL72 disponibles de forma generalizada.

La empresa mostró una demostración de un sistema GB200 NVL72 en uno de sus centros de datos en noviembre del año pasado. El clúster proporcionó hasta 1,4 exaFLOPS de computación de IA.

En enero de 2025, se informó que IBM utilizaría la plataforma en la nube de CoreWeave para acceder a los clústeres Nvidia GB200, que incluyen los sistemas GB200 NVL72 para entrenar su próxima generación de modelos Granite AI.

Deja una respuesta

LOGO

Esta impresionante propiedad de casa de playa es un verdadero oasis, ubicado en una serena comunidad costera con acceso directo a la playa.

Horario de apertura

Lunes - Viernes: 9:00 a 17:00 horas

Domingo: Cerrado

Cerrado durante las vacaciones

Contacto

+18888888888

hezuo@eyingbao.com123 West Street, Melbourne Victoria 3000 Australia